python爬取某人所有朋友圈,python 抓取微博評論破億_Python爬蟲實戰演練:爬取微博大V的評論數據

python爬取某人所有朋友圈,python 抓取微博評論破億_Python爬蟲實戰演練:爬取微博大V的評論數據

本文的文字及圖片來源于網絡,僅供學習、交流使用,不具有任何商業用途,如有問題請及時聯系我們以作處理。

以下文章來源于IT共享之家 ,作者: IT共享者

理論篇

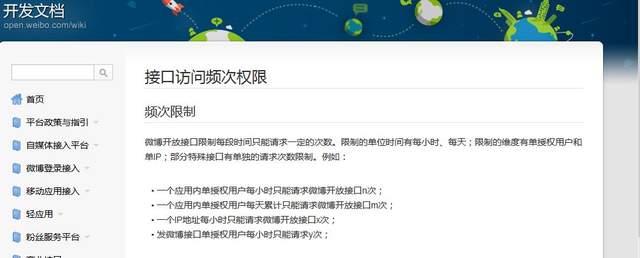

python爬取某人所有朋友圈?試想一個問題,如果我們要抓取某個微博大V微博的評論數據,應該怎么實現呢?最簡單的做法就是找到微博評論數據接口,然后通過改變參數來獲取最新數據并保存。首先從微博api尋找抓取評論的接口,如下圖所示。

但是很不幸,該接口頻率受限,抓不了幾次就被禁了,還沒有開始起飛,就涼涼了。

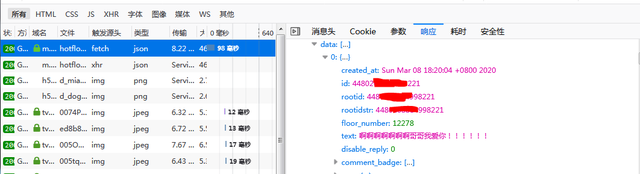

接下來小編又選擇微博的移動端網站,先登錄,然后找到我們想要抓取評論的微博,打開瀏覽器自帶流量分析工具,一直下拉評論,找到評論數據接口,如下圖所示。

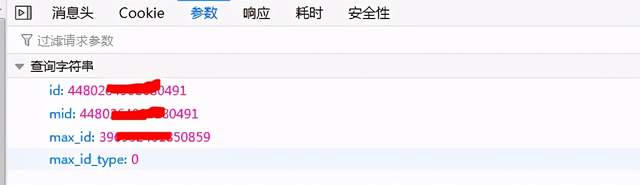

之后點擊“參數”選項卡,可以看到參數為下圖所示的內容:

python爬取淘寶評論。可以看到總共有4個參數,其中第1、2個參數為該條微博的id,就像人的身份證號一樣,這個相當于該條微博的“身份證號”,max_id是變換頁碼的參數,每次都要變化,下次的max_id參數值在本次請求的返回數據中。

實戰篇

有了上文的基礎之后,下面我們開始擼代碼,使用Python進行實現。

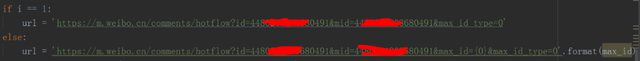

1、首先區分url,第一次不需要max_id,第二次需要用第一次返回的max_id。

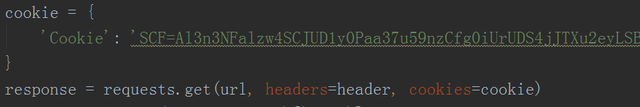

爬蟲數據抓取?2、請求的時候需要帶上cookie數據,微博cookie的有效期比較長,足夠抓一條微博的評論數據了,cookie數據可以從瀏覽器分析工具中找到。

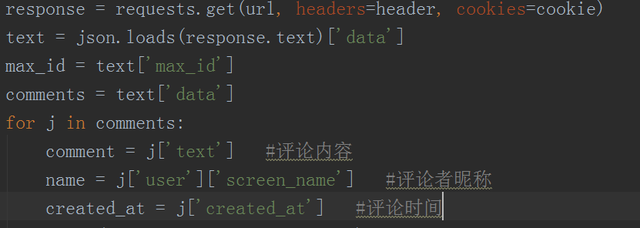

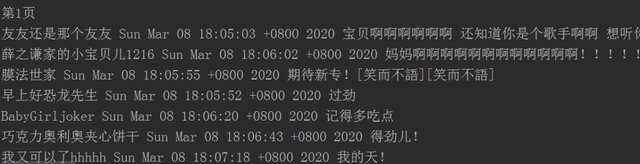

3、然后將返回數據轉換成json格式,取出評論內容、評論者昵稱和評論時間等數據,輸出結果如下圖所示。

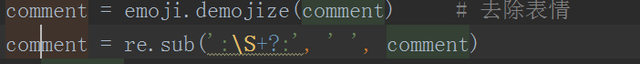

4、為了保存評論內容,我們要將評論中的表情去掉,使用正則表達式進行處理,如下圖所示。

5、之后接著把內容保存到txt文件中,使用簡單的open函數進行實現,如下圖所示。

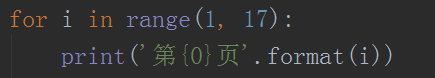

python爬蟲怎么找數據,6、重點來了,通過此接口最多只能返回16頁的數據(每頁20條),網上也有說返回50頁的,但是接口不同、返回的數據條數也不同,所以我加了個for循環,一步到位,遍歷還是很給力的,如下圖所示。

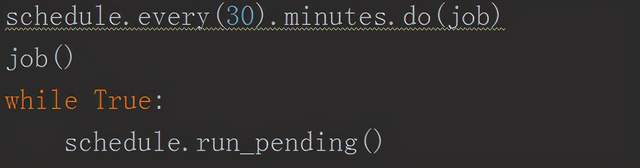

7、這里把函數命名為job。為了能夠一直取出最新的數據,我們可以用schedule給程序加個定時功能,每隔10分鐘或者半個小時抓1次,如下圖所示。

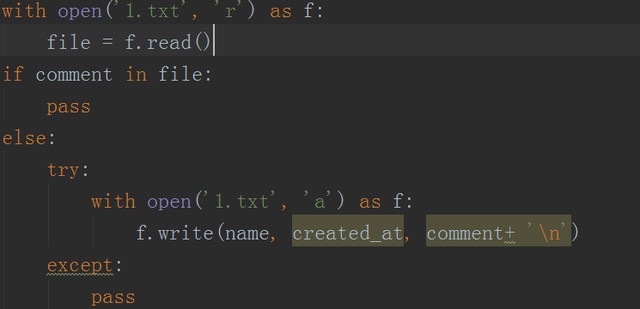

8、對獲取到的數據,做去重處理,如下圖所示。如果評論已經在里邊的話,就直接pass掉,如果沒有的話,繼續追加即可。

這項工作到此就基本完成了。